OpenAI

Prism

OpenAI entre sur le terrain de la rédaction scientifique avec Prism, un éditeur LaTeX dans le navigateur intégrant GPT-5.2. Issu du rachat de Crixet, l’outil propose la conversion de croquis en LaTeX, la recherche de littérature sur arXiv et la collaboration en temps réel sans limite de co-auteurs.

Anthropic

Petri 2.0

Anthropic sort Petri 2.0, la nouvelle version de son framework open source qui teste automatiquement les comportements problématiques des modèles d’IA. Principale nouveauté : un filtre de réalisme qui empêche les modèles de détecter qu’ils sont en train d’être évalués, un problème récurrent dans les audits de sécurité. L’outil, déjà adopté par le UK AI Safety Institute, orchestre des conversations multi-tours entre un auditeur, un modèle cible et un juge. Un pas concret vers des audits de sécurité moins manipulables.

MCPs App

Anthropic intègre dix applications directement dans l’interface de Claude : Slack, Figma, Canva, Asana, Amplitude et d’autres. Concrètement, on peut désormais créer une présentation Canva, envoyer un message Slack ou piloter un projet Asana sans quitter la conversation.

In Excel

Anthropic attaque Microsoft sur son propre terrain. Claude s’intègre désormais dans Excel via un panneau latéral, capable de lire, modifier et créer des classeurs avec des citations au niveau de chaque cellule.

Google

Genie

Google DeepMind dévoile Project Genie, un prototype qui génère des environnements 3D interactifs à la volée grâce à son modèle Genie 3. L’utilisateur décrit un monde par texte ou image, puis s’y déplace librement, le décor se construisant en temps réel autour de lui. Physique simulée, remix de mondes existants : le potentiel est là même si le rendu reste approximatif. Le potentiel est fou.

Agentic vision

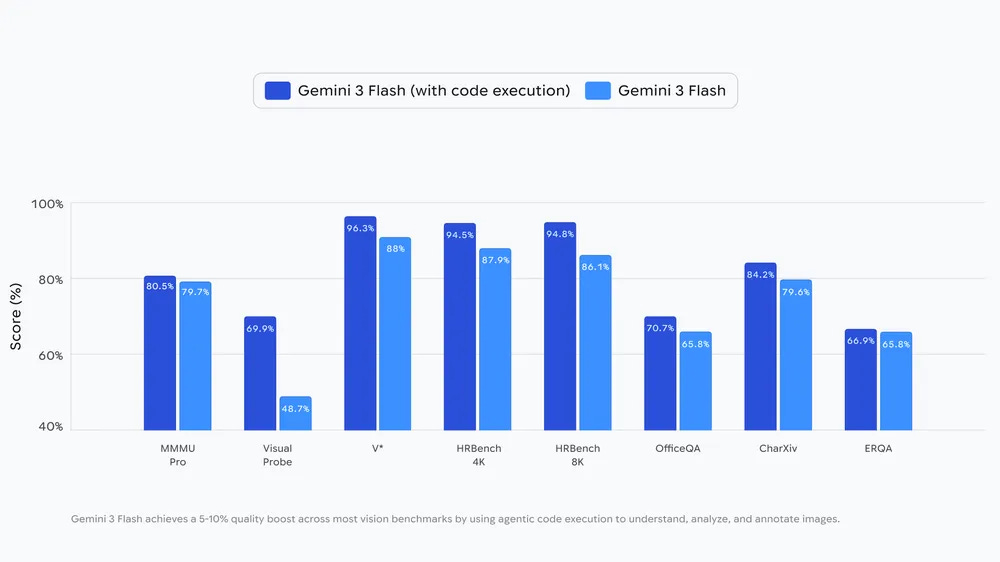

Gemini 3 Flash gagne une fonctionnalité « Agentic Vision » : au lieu d’analyser une image en un coup d’oeil, le modèle peut désormais zoomer, recadrer et exécuter du Python pour inspecter les détails. Une boucle itérative qui améliore les scores vision de 5 à 10 % selon Google. Disponible dès maintenant via l’API Gemini et Vertex AI, la feature vise les cas concrets comme l’analyse de plans techniques ou de tableaux denses. Rien de comparable chez OpenAI ou Anthropic pour l’instant.

Chrome auto browse

Google intègre Gemini directement dans Chrome avec un panneau latéral permanent et des fonctions agentiques « Chrome auto browse », qui peut enchaîner des actions complexes comme réserver un vol ou remplir des formulaires à la place de l’utilisateur. Le navigateur se connecte aussi à Gmail, Calendar, Maps et YouTube pour centraliser le contexte. Google pousse également le Universal Commerce Protocol (UCP), un standard ouvert co-développé avec Shopify, Etsy et Target pour structurer le e-commerce via IA. Pour l’instant, réservé aux abonnés AI Pro et Ultra, et uniquement aux États-Unis.

Alibaba

Alibaba publie Qwen3-TTS en open source (Apache 2.0), deux modèles de synthèse vocale capables de cloner une voix à partir de trois secondes d’audio. Le système supporte dix langues dont le français. L’intérêt principal : un TTS performant déployable en local, sans envoyer de données vocales dans le cloud. Un argument de poids pour la conformité RGPD. Le support linguistique reste limité face à ElevenLabs ou OpenAI, et la qualité fait débat. Mais pour du self-hosting, c’est aujourd’hui une bonne option open source.

☠️ Dario Amodei (Anthropic) alerte sur les risques civilisationnels de l’IA

📚 21 leçons après 14 ans chez Google

❓Les modèles ouverts coûtent 87 % moins cher, mais personne ne les utilise

I Gave Claude Code 9.5 Years of Health Data to Help Manage My Thyroid Disease

Ian Rowan, atteint de la maladie de Graves sous forme épisodique, a décidé d’en faire quelque chose : il a confié 9,5 ans de données Apple Watch à Claude Code pour tenter de détecter ses crises d’hyperthyroïdie avant qu’elles ne se manifestent cliniquement.

Le problème avec la forme épisodique de Graves, c’est l’imprévisibilité. Le protocole classique (symptômes, prise de sang, confirmation) arrive toujours trop tard, les hormones thyroïdiennes ayant une demi-vie d’une à deux semaines. L’idée : exploiter les signaux biométriques continus pour anticiper. Et le résultat est presque décevant de simplicité. Pas de deep learning, pas d’architecture complexe. Un XGBoost avec trois features engineered suffit à produire un score de risque exploitable. Claude Code a même généré un pipeline d’export CoreML pour faire tourner le modèle directement sur l’Apple Watch, sans connexion.

L’auteur est le premier à le dire : c’est du n=1, ça ne généralisera pas forcément à d’autres patients. Mais la démarche est parlante. Des millions de personnes portent des capteurs biométriques en continu, et ces données restent largement inexploitées.

LLMs interpret plots well, until expectations interfere

On fait de plus en plus confiance aux LLMs pour analyser des données, générer des graphiques et en tirer des conclusions. Mais que se passe-t-il quand le plot montre l’inverse de ce que le modèle « sait » ? L’équipe AI de Posit (Simon Couch et Sara Altman) a creusé la question avec bluffbench, un package R d’évaluation dédié.

Le principe est malin : on donne au LLM un dataset connu (comme mtcars) dont les données ont été secrètement modifiées pour produire des tendances contre-intuitives, par exemple des voitures plus puissantes qui consomment moins. Le modèle doit créer un graphique puis décrire ce qu’il observe. Résultat : les LLMs ont une fâcheuse tendance à décrire ce qu’ils s’attendent à voir plutôt que ce que le graphique montre réellement. Là où un analyste humain noterait l’anomalie et creuserait, le LLM plaque ses présupposés issus du pre-training sur la visualisation.

Le benchmark se décline en deux volets : datasets connus (où le biais de mémorisation joue à plein) et données synthétiques avec des noms de colonnes évocateurs mais des corrélations inversées. Dans les deux cas, la priorité donnée aux attentes sur l’évidence reste un problème systématique.

Pour quiconque construit des agents data science, c’est un rappel important : un LLM qui « hallucine » sur du texte, on connaît. Un LLM qui hallucine sur un graphique qu’il a lui-même généré, c’est plus insidieux.

ATLAS: Practical scaling laws for multilingual models

Google DeepMind publie ATLAS (Adaptive Transfer Scaling Laws), la plus grande étude publique de pré-entraînement multilingue à ce jour : 774 runs d’entraînement, des modèles de 10M à 8B de paramètres, plus de 400 langues dans le corpus MADLAD-400, 48 langues d’évaluation. L’ambition est claire : formaliser la fameuse « curse of multilinguality » avec des lois prédictives exploitables.

Le cœur du travail repose sur une matrice de transfert cross-lingue couvrant 1 444 paires de langues. ATLAS quantifie le bénéfice mutuel entre langues et en tire une règle simple : doubler le nombre de langues supportées exige environ 1,18x la taille du modèle et 1,66x le volume de données. Le transfert positif est bien réel, mais asymétrique. Le norvégien profite du suédois, le malais de l’indonésien, et l’anglais reste le meilleur « donneur universel » grâce à la qualité et la diversité de ses données web.

How to Switch to ty from Mypy

Mypy a longtemps régné sans partage sur le type checking Python. Lent, parfois cryptique dans ses messages d’erreur, mais indispensable. Astral, l’équipe derrière Ruff et uv, propose désormais ty : un type checker écrit en Rust qui ambitionne de remplacer Mypy.

Les chiffres parlent d’eux-mêmes. Sur le projet Home Assistant, ty boucle l’analyse en environ 2 secondes là où Mypy en demande 45. En pratique, ça change la donne pour l’intégration IDE, où le feedback quasi instantané devient la norme plutôt que l’exception.

Côté fonctionnalités, ty introduit des intersection types natifs, un type narrowing avancé et une analyse de reachability poussée. Les messages d’erreur s’inspirent directement du compilateur Rust, ce qui est une excellente nouvelle pour quiconque a déjà pesté contre les diagnostics parfois sibyllins de Mypy. La migration se fait en douceur : ty se lance via uvx sans installation, et la configuration reprend une logique familière.

Un bémol toutefois : ty est encore en bêta. Astral prévient que des bugs et des features manquantes sont à prévoir. Pour la prod, mieux vaut garder Mypy en parallèle encore quelques mois à mon avis.

How I Structure My Data Pipelines

Medallion, Kimball, semantic layer : trois patterns omniprésents dans les discussions d’architecture data, souvent présentés comme des approches concurrentes ou interchangeables. Tim Castillo propose de les réconcilier en les assignant chacun à la couche où ils excellent.

Ce qui rend l’approche intéressante, c’est la séparation nette des consommateurs par couche. Gold sert les analystes et outils BI en self-service. Silver reste accessible aux data scientists qui ont besoin du grain complet. Bronze sert au debug et à l’audit. On sort enfin du flou où tout le monde requête la même couche sans savoir ce qui est « propre ».

copilot-sdk

Construire un agent fiable n’est pas si simple : gestion du contexte entre les tours de conversation, orchestration des outils, routing des modèles, garde-fous de sécurité. GitHub vient de mettre en technical preview un SDK qui externalise toute cette plomberie en exposant le même runtime agent que Copilot CLI, sous forme programmable.

Rewarding the Rare: Uniqueness-Aware RL for Creative Problem Solving in LLMs

Reinforcement learning (RL) has become a central paradigm for post-training large language models (LLMs), particularly for complex reasoning tasks, yet it often suffers from exploration collapse: policies prematurely concentrate on a small set of dominant reasoning patterns, improving pass@1 while limiting rollout-level diversity and gains in pass@k. We argue that this failure stems from regularizing local token behavior rather than diversity over sets of solutions. To address this, we propose Uniqueness-Aware Reinforcement Learning, a rollout-level objective that explicitly rewards correct solutions that exhibit rare high-level strategies. Our method uses an LLM-based judge to cluster rollouts for the same problem according to their high-level solution strategies, ignoring superficial variations, and reweights policy advantages inversely with cluster size. As a result, correct but novel strategies receive higher rewards than redundant ones. Across mathematics, physics, and medical reasoning benchmarks, our approach consistently improves pass@k across large sampling budgets and increases the area under the pass@k curve (AUC@K) without sacrificing pass@1, while sustaining exploration and uncovering more diverse solution strategies at scale.