Anthropic

Anthropic sort Sonnet 4.6 : Sonnet 5 attendra

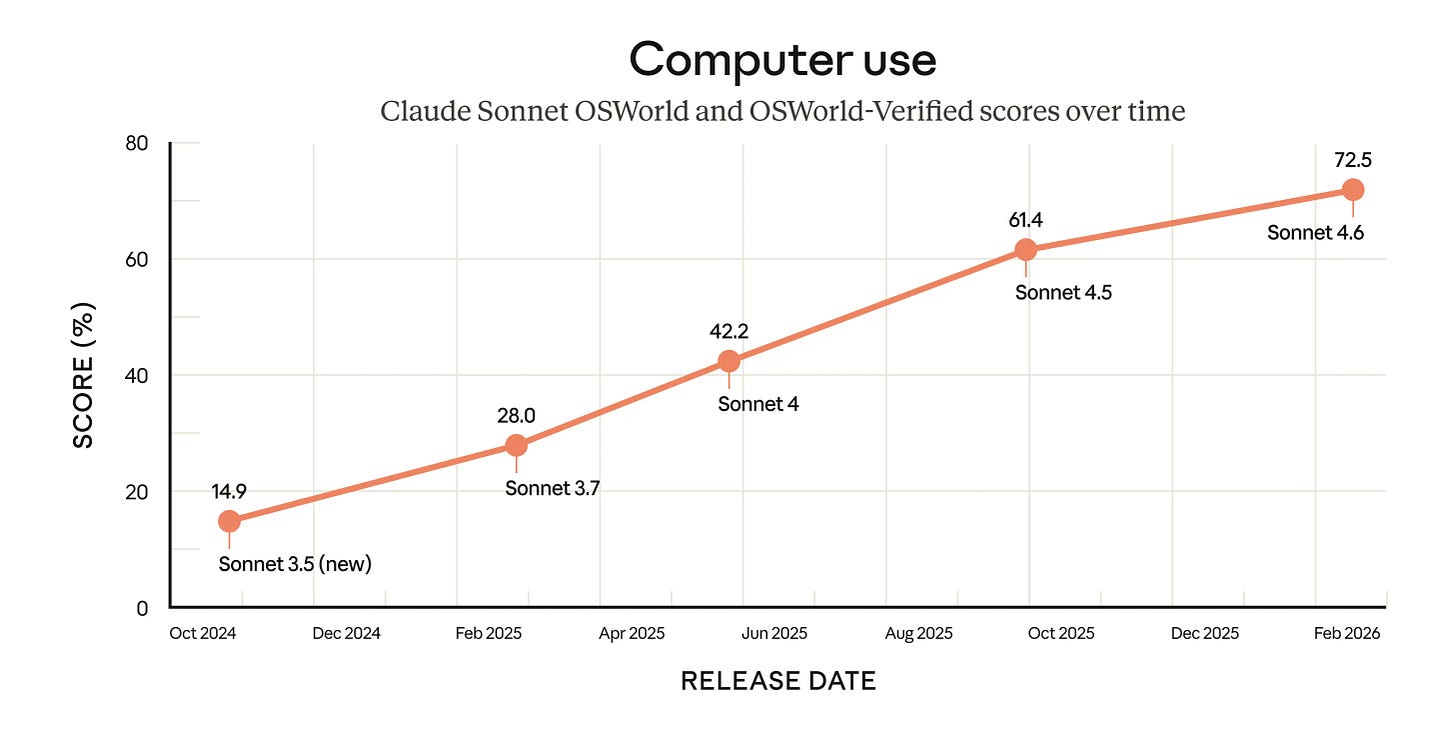

Anthropic a lancé Claude Sonnet 4.6. Des performances proches d'Opus pour cinq fois moins cher (3/15 $ par million de tokens). Fenêtre de contexte d'un million de tokens, computer use nettement amélioré. Pourtant, un leak Vertex AI pointait vers un « Sonnet 5 » nom de code Fennec pour début février. Anthropic a choisi l'incrément plutôt que le changement de génération, Sonnet 5 reste donc dans les cartons pour le moment.

OpenAI

GPT-5.3-Codex-Spark

OpenAI lance GPT-5.3-Codex-Spark, il tourne sur les puces Cerebras WSE-3 et non sur GPU Nvidia. C’est une première. Le modèle envoie plus de 1 000 tokens par seconde, ce qui le rend très agréable à utiliser dans Codex. Disponible en preview pour les abonnés ChatGPT Pro uniquement, avec 128k tokens de contexte. Derrière l’annonce technique, c’est surtout le deal à 10 milliards de dollars avec Cerebras, signé en janvier, qui prend forme. OpenAI diversifie ses fournisseurs d’inférence, et Nvidia perd son exclusivité.

Lockdown Mode

OpenAI ajoute un « Lockdown Mode » à ChatGPT pour limiter l'exfiltration de données via injection de prompts. Le principe : couper les ponts avec l'extérieur. Navigation web restreinte au cache, images désactivées, Deep Research et mode Agent coupés. Réservé pour l'instant aux offres Enterprise, Edu et Healthcare, le mode cible les profils et organisations sensibles.

OpenAI met à la retraite GPT-4o et ses anciens modèles

OpenAI retire GPT-4o, GPT-4.1, GPT-4.1 mini et o4-mini de ChatGPT. GPT-5.2 devient le modèle par défaut. Seuls 0,1 % des utilisateurs sélectionnaient encore GPT-4o au quotidien. OpenAI avait déjà tenté cette suppression l'an dernier avant de faire marche arrière face au tollé. Cette fois, c'est acté. L'API conserve un sursis, mais le message est clair : la page GPT-4 est tournée.

Google

Gemini 3 Deep Think

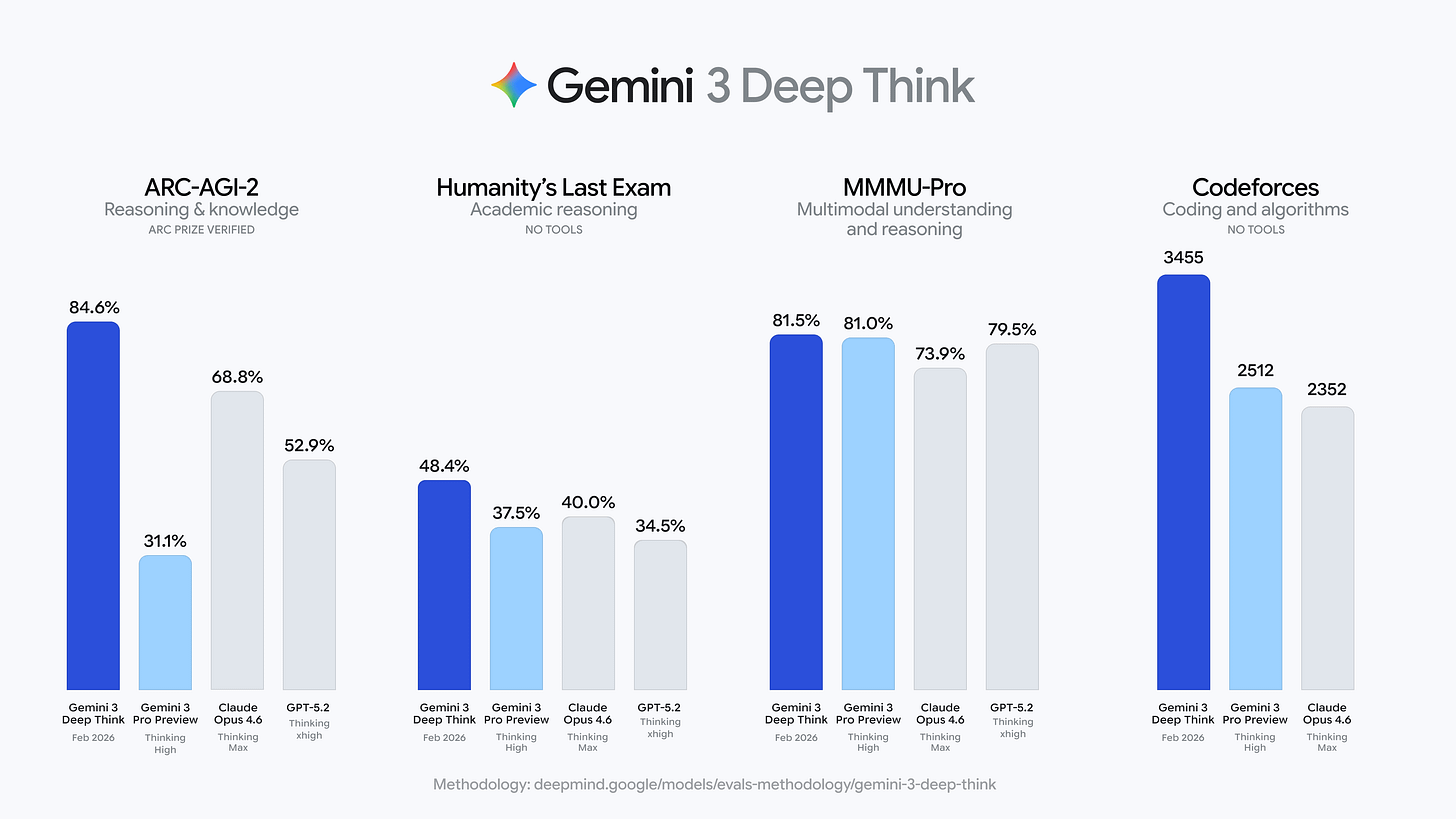

Google met à jour Deep Think. Les résultats sont impressionnants et parlent d'eux-mêmes : un score de 84.6% ARG-AGI 2 loin devant le second (Opus 4.6) à 68.8%. Le mode est disponible pour les abonnés Google AI Ultra et bientôt via API.

Google pose les bases du web agentique avec WebMCP

Google lance WebMCP en early preview dans Chrome 146, un protocole co-développé avec Microsoft et incubé au W3C. Le principe : permettre aux sites d'exposer des outils structurés aux agents IA via deux API (déclarative en HTML, impérative en JavaScript), plutôt que de les laisser naviguer à l'aveugle dans le DOM. Concrètement, un site e-commerce ou une compagnie aérienne pourrait offrir aux agents un accès direct à ses fonctions de recherche et de réservation.

xAI

Grok 4.2 en bêta publique

xAI a mis en ligne Grok 4.2 en bêta publique le 17 février. Le modèle introduit quatre agents parallèles qui collaborent sur une même requête et des mises à jour hebdomadaires basées sur les retours utilisateurs. Elon Musk promet une version finale en mars, « un ordre de grandeur » au-dessus de Grok 4. Pour l'instant, Grok 4.1 reste en retrait face à Claude et Gemini sur la plupart des benchmarks. Résultats à confirmer.

Grok x médical

xAI permet désormais d'envoyer ses radios et IRM à Grok pour obtenir un diagnostic. Elon Musk affirme que son IA fait parfois mieux que les médecins, s'appuyant sur un cas anecdotique relayé sur Reddit. En réalité, Grok n'a aucune certification médicale (FDA ou autre), et les résultats sont jugés très inégaux par les radiologues. Quant aux données de santé envoyées à X, les experts en éthique médicale s'inquiètent ouvertement de leur utilisation.

ByteDance

Seedance 2.0

ByteDance dégaine Seedance 2.0, une famille de trois modèles (Pro, Lite, Mini) qui impressionnent par la qualité des vidéos. Seedance 2.0 a immédiatement provoqué la colère d'Hollywood et de Disney pour usage non autorisé de leurs personnages.

📐 OpenAI crédite GPT-5.2 d'une contribution originale en physique théorique

🤖 Tesla déploie plus de 1 000 robots Optimus dans ses usines

📚 Anthropic publie de nouvelles données sur l'autonomie des agents IA

💰 Simile lève 100 millions pour simuler des populations avec des agents IA

🛒 Mistral s'offre Koyeb, sa première acquisition

Two different tricks for fast LLM inference

La course à l’inférence rapide bat son plein, et les deux approches en lice ne pourraient pas être plus différentes. Anthropic réduit la taille des batches pour servir Opus 4.6 en mode « fast lane » : 170 tokens par seconde (2,5x), mais à 6x le prix. OpenAI sort l’artillerie lourde avec les puces géantes Cerebras (70 pouces carrés de silicium contre un seul pour un H100) et dépasse les 1 000 tokens par seconde, mais sur Spark, un modèle distillé nettement moins capable que le vrai Codex.

Le trade-off est limpide. Anthropic facture le vrai modèle, sans compromis sur la qualité. OpenAI gagne un facteur 15x grâce au SRAM massif (44 Go) des puces Cerebras, mais Spark trébuche sur les tool calls et les tâches complexes.

Sean Goedecke met le doigt sur un point sous-estimé : en mode agentique, la vitesse brute compte moins que la fiabilité. Un agent 6x plus rapide qui fait 20 % d’erreurs en plus finit par coûter plus cher en correction. À surveiller : si ces modèles rapides deviennent des primitives bas-niveau, le calcul économique pourrait changer.

What do “economic value” benchmarks tell us?

Mesurer si un LLM peut « remplacer un travailleur » est devenu le nouveau sport des labos. Epoch AI passe au crible trois benchmarks qui s'y essaient (RLI, GDPval, APEX-Agents) et le constat est nuancé.

Les trois approches couvrent des tâches très différentes : du montage vidéo freelance (RLI, 29h de travail humain en moyenne) à l'analyse juridique en cabinet (APEX-Agents, 2h), en passant par un large éventail de métiers numériques (GDPval, 7h). Les scores reflètent cette hétérogénéité : Opus 4.6 plafonne à 4 % sur RLI mais atteint 30 % sur APEX-Agents, tandis que GPT-5.2 Pro culmine à 74 % sur GDPval. Sauf que GDPval fournit des tâches bien encadrées, sans le désordre d'un vrai poste de travail, et certaines questions sont déjà dépassées par l'actualité.

Le point le plus intéressant reste la conclusion : même saturés, ces benchmarks ne mesureraient pas l'automatisation d'un métier, mais la capacité à exécuter des tâches isolées. L'analogie avec SWE-bench est parlante. On accélère l'exécution, on ne supprime pas le besoin de planification, de contexte métier et de vérification humaine.

Scaling LLM Post-Training at Netflix

On peut fine-tuner des LLMs en quelques lignes de code sur un notebook. Puis vient le moment de passer en production sur un cluster multi-noeud GPU, et le fossé entre le script qui tourne et le pipeline robuste devient vertigineux. Netflix vient de documenter son framework interne de post-training, et c'est une lecture qui peut parler à quiconque a tenté de scaler du fine-tuning.

L'architecture repose sur quatre piliers (Data, Model, Compute, Workflow) construits au-dessus de PyTorch, Ray et vLLM. Côté données, le framework gère le packing dynamique de séquences à la volée pour éviter le padding inutile, avec un gain de throughput allant jusqu'à 4.7x sur les datasets à forte variance de longueur. Côté modèle, Netflix maintient ses propres définitions optimisées tout en restant compatible Hugging Face pour les checkpoints, un choix pragmatique qui évite le walled garden tout en permettant des optimisations comme FlashAttention ou le chunked cross-entropy.

Un retour d'expérience intéressant.

Is Your “Human-in-the-Loop” Actually Slowing You Down? Here’s What We Learned

Quand on déploie une IA (qui automatise certains processus, par exemple), on ajoute souvent une validation humaine avant de laisser passer les propositions. Ça rassure tout le monde, sauf qu’en pratique, les reviewers passent 60 % de leur temps sur des cas triviaux que le modèle gère très bien tout seul.. La validation humaine devient alors un goulot d'étranglement.

L'équipe de CapeStart partage deux ans de retour d'expérience sur une refonte complète de leur approche. L'idée centrale : ne pas traiter toutes les prédictions de la même façon. Un routeur léger classe chaque décision en trois niveaux. Les cas à haute confiance (85 % du trafic) passent en validation automatique. Les cas ambigus (12 %) sont envoyés en review asynchrone vers des experts, avec un retour sous 4 à 6 heures. Seuls les scénarios à haut risque (3 %) déclenchent une intervention humaine en temps réel.

L'autre leçon, moins évidente : les reviewers ne perdaient pas leur temps à décider, mais à chercher le contexte. En pré-calculant les informations nécessaires dans l'interface de review, le temps moyen est passé de 6 minutes à 90 secondes. Résultat global : taux de faux négatifs divisé par quatre et capacité de traitement quasi doublée.

Entire CLI

Le principe de cet outil est simple et plutôt malin : à chaque commit généré par un agent, Entire capture automatiquement un « checkpoint » qui stocke le transcript complet, les prompts, les fichiers touchés, les tool calls et la consommation de tokens. Ces métadonnées sont versionnées dans une branche dédiée (`entire/checkpoints/v1`), ce qui crée un audit log append-only directement dans le repo Git. Concrètement, on passe du « quoi a changé » au « pourquoi ça a changé », et ça change la donne pour les code reviews sur du code généré.

L'ambition va au-delà du simple logging : Entire veut devenir une couche de raisonnement partagé entre agents, un « semantic reasoning layer » qui permettrait la coordination multi-agents sans perte de contexte. Le support démarre avec Claude Code et Gemini CLI, Codex et Cursor suivront. La thèse de fond est que le cycle de développement logiciel actuel, pensé pour la collaboration humain-humain, ne tient plus face aux flux massifs de code généré par des agents. Reste à voir si le marché suivra cette vision ambitieuse, ou si Git natif finira par intégrer ce type de fonctionnalité.

Je vous recommande de tester pour comprendre comment l’outil fonctionne.

RowBoat

RowBoat est un assistant IA local qui se connecte à Gmail et aux outils de notes de réunion (Granola, Fireflies) pour construire un graphe de connaissances persistant : personnes, projets, décisions, engagements. Le tout stocké en fichiers Markdown compatibles Obsidian, inspectables et éditables.

Contrairement aux outils qui font du RAG à froid à chaque interaction, RowBoat accumule le contexte au fil du temps. Il génère des briefs de réunion, rédige des emails ancrés dans l'historique, et s'étend via MCP pour brancher Slack, GitHub ou Linear. Côté modèles, c'est BYOM via Ollama, LM Studio ou API. Tout reste en local, sans dépendance cloud.

Voicebox

Alternative open source (MIT) à ElevenLabs, entièrement en local. Voicebox s'appuie sur Qwen3-TTS d'Alibaba pour cloner une voix à partir de quelques secondes d'audio. L'app desktop embarque un éditeur multi-pistes pour composer des narratifs multi-voix, avec une API REST pour l'intégration.

Sur Apple Silicon, le backend MLX accélère l'inférence 4 à 5 fois par rapport à PyTorch. Aucune dépendance cloud : les données vocales ne quittent jamais la machine, un point non négligeable côté RGPD.

Accelerating Scientific Research with Gemini: Case Studies and Common Techniques

Recent advances in large language models (LLMs) have opened new avenues for accelerating scientific research. While models are increasingly capable of assisting with routine tasks, their ability to contribute to novel, expert-level mathematical discovery is less understood. We present a collection of case studies demonstrating how researchers have successfully collaborated with advanced AI models, specifically Google's Gemini-based models (in particular Gemini Deep Think and its advanced variants), to solve open problems, refute conjectures, and generate new proofs across diverse areas in theoretical computer science, as well as other areas such as economics, optimization, and physics. Based on these experiences, we extract common techniques for effective human-AI collaboration in theoretical research, such as iterative refinement, problem decomposition, and cross-disciplinary knowledge transfer. While the majority of our results stem from this interactive, conversational methodology, we also highlight specific instances that push beyond standard chat interfaces. These include deploying the model as a rigorous adversarial reviewer to detect subtle flaws in existing proofs, and embedding it within a "neuro-symbolic" loop that autonomously writes and executes code to verify complex derivations. Together, these examples highlight the potential of AI not just as a tool for automation, but as a versatile, genuine partner in the creative process of scientific discovery.