Anthropic

Anthropic publie une étude sur l'impact (encore limité) de l'IA sur l'emploi

Anthropic a analysé les données du marché du travail américain en croisant ses propres données d'usage de Claude avec les statistiques fédérales. Résultat : pas de hausse significative du chômage dans les métiers les plus exposés à l'IA depuis fin 2022. Les programmeurs, service client et analystes financiers sont en première ligne, mais les effets restent pour l'instant statistiquement invisibles. Seul signal : l'embauche des 22-25 ans ralentit dans les professions exposées, suggérant que l'IA freine l'entrée sur le marché plutôt qu'elle ne pousse dehors. Un constat qui pourrait vite changer à mesure que l'adoption s'accélère.

Claude Code s'étoffe : code review multi-agent et mode vocal

Grosse semaine pour Claude Code, Anthropic intègre plusieurs nouveaux éléments. En particulier, un système de review automatique des pull requests : plusieurs agents IA analysent le code en parallèle, vérifient chaque bug détecté avant de le signaler, et classent les problèmes par sévérité. En interne, le taux de PR recevant des commentaires substantifs est passé de 16 % à 54 %. Sur les grosses PR (1000+ lignes), 84 % révèlent des problèmes, avec 7,5 issues en moyenne. Deuxième ajout utile : un mode vocal activé via ‘/voice’. Push-to-talk avec la barre espace, pas d'écoute permanente, pas de surcoût.

Copilot Cowork et add-ins Excel/PowerPoint

Double offensive pour Claude dans l'univers Microsoft. D'un côté, Microsoft lance Copilot Cowork, un agent multi-étapes pour Outlook, Teams et Excel et c'est la technologie Claude d'Anthropic qui propulse le moteur de raisonnement, pas OpenAI. L'outil transforme une consigne simple en plan d'action avec points de contrôle. GA prévue le 1er mai, intégré au forfait M365 E7 à 99 $/utilisateur/mois. De l'autre, Anthropic met à jour ses propres add-ins Claude pour Excel et PowerPoint.

Les deux applications partagent désormais le contexte d'une même conversation : Claude peut lire un tableur, construire une analyse financière, puis mettre à jour une présentation sans réexplication. Les « Skills » permettent d'enregistrer un workflow complet en un clic pour le rendre réutilisable par toute l'équipe. Anthropic joue sur les deux tableaux, à l'intérieur de Copilot et en parallèle avec ses propres add-ins.

OpenAI

GPT-5.4

OpenAI sort GPT-5.4, son nouveau modèle phare, disponible dans ChatGPT, l'API et Codex. Au menu : contexte d'un million de tokens, computer use natif (une première pour un modèle généraliste !) et une API de recherche d'outils qui réduit la consommation de tokens de 47 % sur les workflows multi-outils. Le prix monte légèrement à 2,50 $/15 $ par million de tokens en entrée/sortie (contre 1,75 $/14 $ pour GPT-5.2). Les variantes mini et nano sont aussi disponibles.

ChatGPT et apprentissage

OpenAI intègre des visualisations interactives dans ChatGPT pour explorer formules et concepts scientifiques. Concrètement, les utilisateurs peuvent manipuler des variables et observer en temps réel l'effet sur les graphiques. Plus de 70 sujets sont couverts au lancement, du théorème de Pythagore à la loi des gaz parfaits, pour un niveau lycée et supérieur. La fonctionnalité est accessible sur tous les forfaits, gratuit compris. OpenAI revendique 140 millions d'utilisateurs hebdomadaires sur des cas d'apprentissage. Reste à voir si ces widgets feront mieux que les dizaines d'applis éducatives déjà sur le marché.

Google

Gemini dans Maps

Google intègre Gemini dans Maps avec deux nouveautés. « Ask Maps » permet de poser des questions en langage naturel et d’obtenir des réponses contextualisées. Côté navigation, « Immersive Navigation » affiche une vue 3D du trajet avec bâtiments, feux et voies matérialisées, générée à partir d'images Street View. Déploiement lancé aux États-Unis et en Inde, vous vous en doutiez mais l’Europe attendra.

Embedding 2

Google sort Gemini Embedding 2, un modèle d'embedding qui unifie texte, images, vidéo, audio et PDF dans un seul espace vectoriel. L'intérêt : une seule requête peut mélanger les modalités, ce qui simplifie les pipelines RAG multimodaux. Sur les benchmarks vidéo et image, aucun concurrent (OpenAI, Amazon Nova 2) ne propose d'équivalent natif. Disponible en preview via Gemini API et Vertex AI.

Gemini dans workspace

Google intègre Gemini en profondeur dans Docs, Sheets, Slides et Drive. Le plus notable : Sheets peut désormais construire un tableur complet à partir d'une description en langage naturel, en croisant données de Gmail, Drive et du web. Côté Slides, l'IA génère des présentations entières à partir d'un simple prompt. Drive, lui, se mue en base de connaissances interrogeable. Le tout réservé pour l'instant aux abonnés AI Pro et Ultra, en anglais uniquement.

Microsoft

Copilot Health

Microsoft intègre un espace dédié à la santé dans Copilot. Le principe : centraliser dossiers médicaux, résultats de labo et données de plus de 50 wearables (Apple Health, Oura, Fitbit) pour en tirer des analyses personnalisées. Un panel de 230 médecins dans 24 pays supervise le projet, et la certification ISO 42001 est déjà obtenue. Pour l'instant, accès sur liste d'attente, réservé aux États-Unis.

🧑💼 Karpathy open-source une carte interactive de l'exposition des métiers à l'IA

🤑 Le pari à 1 milliard de Yann LeCun contre les LLMs

🤝 OpenAI rachète Promptfoo pour sécuriser ses agents

🎮 Le photoréalisme dans les jeux vidéo franchit une nouvelle étape avec le DLSS 5

Comparing Python packages for A/B test analysis: tea-tasting, Pingouin, statsmodels, and SciPy

Quel package Python couvre réellement le workflow complet d'expérimentation ?

Ce comparatif met face à face quatre bibliothèques (tea-tasting, Pingouin, statsmodels, SciPy) sur les tâches concrètes du quotidien : t-test de Welch, métriques de type ratio, intervalles de confiance relatifs, CUPED et correction pour tests multiples. Le constat est net. SciPy reste la fondation, mais demande beaucoup de code maison. statsmodels offre des briques solides pour qui accepte d'assembler soi-même le pipeline. Pingouin simplifie les tests classiques dans un workflow pandas, mais décroche dès qu'on touche aux ratios ou au CUPED. tea-tasting, conçu spécifiquement pour l'A/B testing, est le seul à proposer effets relatifs, CUPED sur les ratios et workflow sur statistiques agrégées « out of the box ».

À noter : l'auteur est aussi le créateur de tea-tasting, ce qui colore forcément l'analyse. Le comparatif reste honnête sur les critères factuels, mais le biais de sélection est à garder en tête. Pour les équipes qui industrialisent leurs expérimentations, c'est une grille de lecture utile avant de choisir sa stack.

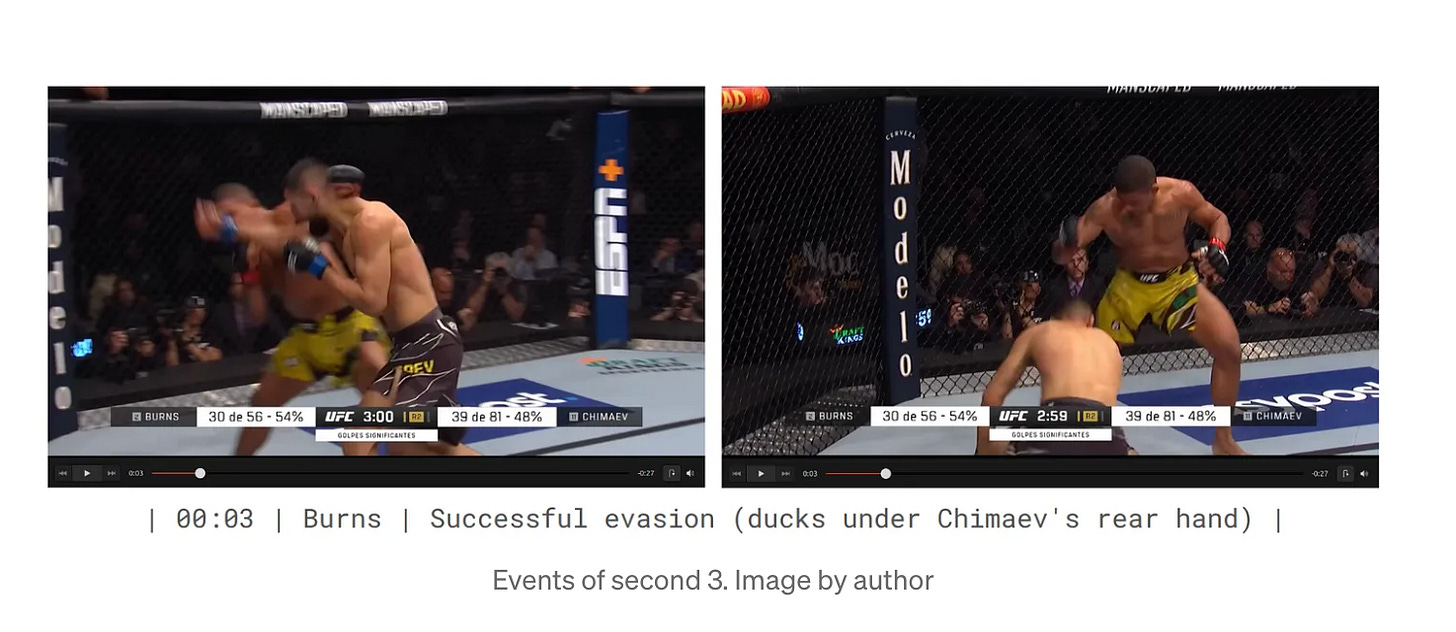

Structured Video Captioning with Gemini: An MMA Analysis Use Case

Analyser de la vidéo frame par frame pour en extraire des événements structurés, c’est le genre de tâche qui relevait encore récemment du pipeline un peu custom avec détection d’objets, tracking et post-traitement. Avec les VLMs capables d’ingérer directement du flux vidéo, la choses sont différentes.

Ce tutoriel propose d’utiliser Gemini pour analyser des combats de MMA seconde par seconde. L’approche repose sur un workflow multi-agent : un premier prompt extrait une timeline brute des actions, puis des « spécialistes » (striking, grappling, submission, mouvement) analysent chacun le même segment sous leur angle. Un « Head Coach » synthétise le tout en un rapport structuré via des modèles Pydantic. Le prompt chaining passe de Gemini 2.5 Pro pour l’analyse visuelle à Flash puis Flash Lite pour la structuration, un choix pragmatique qui maîtrise les coûts.

On notera que Gemini échantillonne à 1 FPS par défaut, ce qui pose problème sur des sports rapides. Monter à 5 FPS améliore la détection, mais fait exploser la consommation de tokens.

L’intérêt ici est de pouvoir donner des insights spécifiques et de guider l’entrainement des athlètes. Au-delà du cas MMA, le pattern multi-agent avec spécialistes disciplinaires est directement transposable à d’autre domaines.

Ten years late to the dbt party (DuckDB edition)

Les pipelines de données bricolés à coups de scripts SQL chaînés, ça « fait le job »... jusqu'au jour où il faut ajouter des tests, gérer l'incrémental, documenter le lineage, et là le château de cartes vacille.

C'est exactement le cheminement que décrit Robin Moffatt dans ce retour d'expérience où il migre un pipeline DuckDB artisanal vers dbt. Le découpage source/staging/marts force une rigueur que le SQL à plat ne peut pas offrir : séparation des responsabilités, freshness checks sur les sources, snapshots pour les Slowly Changing Dimensions, et surtout des tests unitaires et des contracts qui transforment le pipeline en quelque chose de maintenable. L'intégration avec Dagster pour l'orchestration vient boucler la boucle, en apportant monitoring et visualisation du DAG sans effort supplémentaire.

Ce qui rend l'article intéressant, c'est l'honnêteté sur les pièges rencontrés en chemin : données upstream incohérentes, clés dupliquées, labels qui flip-floppent entre deux appels API. Le genre de problèmes que dbt ne résout pas magiquement, mais qu'il rend au moins visibles et testables.

Claude Code isn't going to replace data engineers (yet)

Robin Moffatt dont on vient de voir le retour sur dbt + DuckDB a voulu vérifier sérieusement ce que Claude Code pouvait réellement produire sur un vrai jeu de données, avec un vrai cahier des charges de data engineer senior.

Le résultat est nuancé, Claude Code génère un projet dbt fonctionnel avec staging layers, dimensional modeling, SCD type 2, tests et documentation. Le dbt build passe mais en grattant, les problèmes classiques de l'IA apparaissent : une pagination API mal gérée qui tronque silencieusement les données (1 493 stations récupérées sur 5 458), des colonnes utiles supprimées sans justification, des choix de modélisation discutables jamais présentés pour validation humaine. Le genre d'erreurs qui passent en prod et qu'on découvre trois mois plus tard.

Le constat le plus pertinent : le prompt et les skills dbt Labs comptent davantage que le choix du modèle (Sonnet 4.5 vs Opus 4.6). Et surtout, la bonne posture n'est pas de laisser l'agent construire seul, mais d'itérer avec lui.

Hugging Face : Synthetic Data Playbook

Hugging Face publie un guide complet de génération de données synthétiques, issu de l'expérience accumulée sur FineWeb, Cosmopedia et SmolLM (1+ trillion de tokens). Couvre la chaîne complète : modèles enseignants, seed data, décontamination, infra à grande échelle, avec la stack maison (distilabel, datatrove, lighteval).

AutoResearch

Le dernier side project de Karpathy pour l’automatisation des tâches de machine learning (👋 les data scientists). Un agent IA reçoit un setup d'entraînement et itère en autonomie : il modifie le train.py, lance un run, compare la loss au baseline, garde ou jette, et recommence.

LangWatch

Plateforme open source d'observabilité LLM qui unifie tracing, évaluation et simulation d'agents en un seul outil. Basé sur OpenTelemetry, compatible avec tous les providers et frameworks majeurs. Déploiement cloud, Docker Compose ou Helm, avec option on-prem pour la conformité RGPD.

Context Hub

CLI open source d'Andrew Ng qui fournit aux agents de code une documentation API versionnée et spécifique au langage. L’outil inclut un mécanisme d'annotations locales pour que l'agent capitalise d'une session à l'autre.

MessyData

Par Soda (créateurs de soda-core). On décrit un schéma en YAML, on configure des anomalies (NaN, doublons, dates invalides, outliers), et la lib génère un DataFrame Pandas volontairement « sale ». Distributions configurables par colonne, support temporel pour simuler des séries, seed pour la reproductibilité. Idéal pour tester des pipelines de validation.

Cloudflare /crawl

Un endpoint unique pour crawler un site entier : Cloudflare découvre les pages via sitemaps, les rend en headless browser, et retourne HTML, Markdown ou JSON structuré. Crawl asynchrone, incrémental, configurable en profondeur et patterns d'URL, de quoi remplacer pas mal de scripts maison fragiles.

SWE-CI: Evaluating Agent Capabilities in Maintaining Codebases via Continuous Integration

Large language model (LLM)-powered agents have demonstrated strong capabilities in automating software engineering tasks such as static bug fixing, as evidenced by benchmarks like SWE-bench. However, in the real world, the development of mature software is typically predicated on complex requirement changes and long-term feature iterations -- a process that static, one-shot repair paradigms fail to capture. To bridge this gap, we propose \textbf{SWE-CI}, the first repository-level benchmark built upon the Continuous Integration loop, aiming to shift the evaluation paradigm for code generation from static, short-term \textit{functional correctness} toward dynamic, long-term \textit{maintainability}. The benchmark comprises 100 tasks, each corresponding on average to an evolution history spanning 233 days and 71 consecutive commits in a real-world code repository. SWE-CI requires agents to systematically resolve these tasks through dozens of rounds of analysis and coding iterations. SWE-CI provides valuable insights into how well agents can sustain code quality throughout long-term evolution.